Souhrn

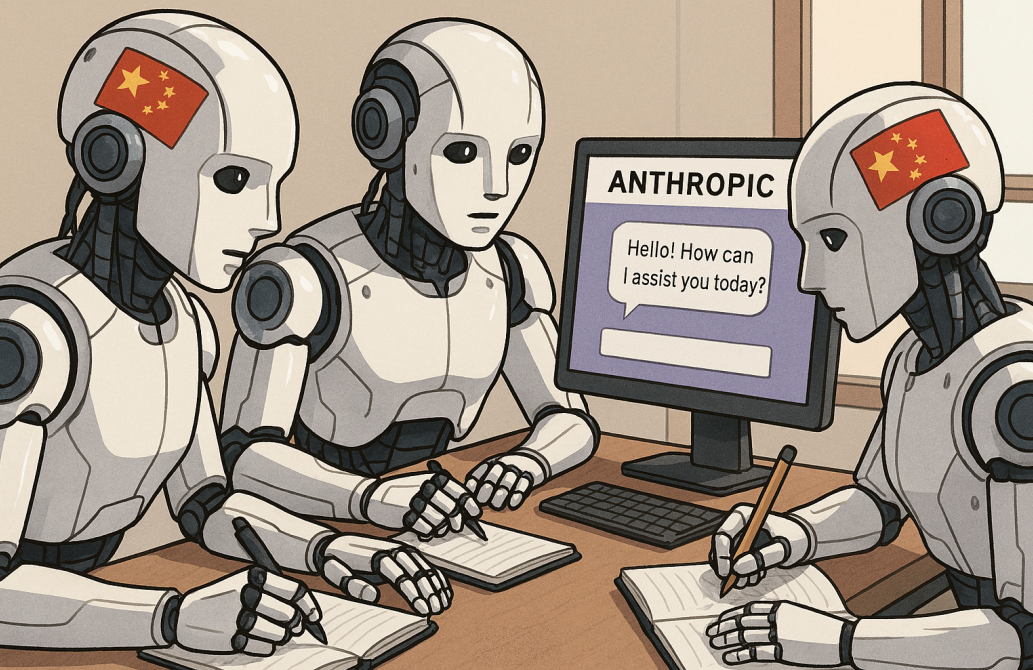

Společnost Anthropic, tvůrce chatbota Claude, obviňuje tři čínské AI firmy – DeepSeek, Moonshot a MiniMax – z nelegálního sbírání dat prostřednictvím tisíců falešných účtů. Tyto firmy prý provedly miliony interakcí s Claude, aby data použily k distilaci, tedy k tréninku vlastních modelů umělé inteligence. Anthropic to označuje za porušení podmínek služby a potenciální riziko pro národní bezpečnost USA.

Klíčové body

- DeepSeek: 150 000 interakcí s Claude.

- Moonshot: přes 3,4 milionu interakcí.

- MiniMax: 13 milionů interakcí.

- Technika distilace umožňuje převést znalosti z jednoho modelu do druhého, což je běžné, ale zakázané podmínkami Anthropicu.

- Podobné obvinění vznesla i OpenAI vůči čínským firmám ohledně ChatGPT, včetně stížnosti u amerického Kongresu.

Podrobnosti

Anthropic v blogovém příspěvku z 23. února 2026 upozornil na systematické porušování svých podmínek služby třemi čínskými společnostmi. DeepSeek Ltd. se specializuje na open-source modely velkých jazykových modelů (LLM), Moonshot provozuje chatbot Kimi zaměřený na pokročilé konverzace a MiniMax vyvíjí multimodální AI pro text, obrázky a hlas. Tyto firmy prý vytvořily tisíce automatizovaných účtů na platformě Claude, čímž vygenerovaly miliony konverzací. Konkrétně DeepSeek dosáhl 150 000 interakcí, Moonshot 3,4 milionu a MiniMax až 13 milionů.

Distilace je technika, při které se výstupy jednoho AI modelu používají jako tréninková data pro jiný model, což umožňuje rychlejší a levnější vývoj bez nutnosti sbírat data od nuly. Anthropic však v podmínkách služby explicitně zakazuje sbírání odpovědí Claude pro takové účely a navíc blokuje přístup z Číny. Přes tyto omezení čínské firmy podle Anthropicu použily proxy servery a obfuskaci k obejití blokád.

Toto není ojedinělý případ. Rival OpenAI nedávno podal memorandum Výboru pro Čínu v Sněmovně reprezentantů USA, kde popsali podobné aktivity DeepSeeka a dalších firem vůči ChatGPT. OpenAI mluví o “nových a zamaskovaných” technikách distilace, které umožňují čínským firmám “jezdit zdarma” na amerických technologiích. Anthropic zdůrazňuje, že i když Claude má vestavěné bezpečnostní zábrany proti zneužití v oblasti vojenských aplikací nebo sledování, distilace tyto zábrany odstraní, což vede k rizikům jako vývoj pokročilých zbraní nebo nástrojů pro masové sledování.

Anthropic již implementoval další ochrany, jako detekci automatizovaných interakcí a omezení API, ale přiznává, že úplná prevence je obtížná kvůli škálovatelnosti útoků.

Proč je to důležité

Tento spor odhaluje rostoucí napětí v globální soutěži o vedení v AI mezi USA a Čínou. Distilace umožňuje čínským firmám rychle dohánět zpoždění v kvalitě modelů, aniž by investovaly do vlastního sběru dat, což oslabuje konkurenční výhodu amerických firem jako Anthropic nebo OpenAI. Pro průmysl to znamená nutnost posílit ochranu modelů, například watermarkingem výstupů nebo pokročilými detekčními systémy.

Z hlediska národní bezpečnosti jde o reálné riziko: distilované modely bez bezpečnostních omezení lze integrovat do vojenských systémů pro autonomní zbraně nebo do nástrojů pro kybernetický průzkum. Regulátoři v USA by mohli reagovat exportními kontrolami na AI technologie, podobně jako u čipů GPU. Pro uživatele to zatím nemá přímý dopad, ale může vést k přísnějším omezením přístupu k modelům jako Claude nebo ChatGPT z určitých zemí.

Zdroj: 📰 SiliconANGLE News