Souhrn

Na CES 2026 Nvidia pod vedením Jensena Huanga oznámila vývoj, který přepracovává ekonomiku tzv. AI továren – obřích datových center určených k tréninku a provozu modelů umělé inteligence. Společnost podle analytiků dále posiluje svou pozici jako standard v hardwaru a softwaru pro příští generaci výpočetních systémů, přestože konkurence tvrdí opak.

Klíčové body

- Nvidia dosahuje ročních zlepšení výkonu pětinačných, propustnosti desetinásobných a poptávky po tokenech patnáctinásobných díky Jevonsovu paradoxu.

- Historická paralela s érou Intelu a Microsoftu: firmy, které se nezaradily do ekosystému, selhaly.

- Oznámení na CES mění dynamiku poptávky po výkonu, propustnosti a využití v AI infrastruktuře.

- Dopady na konkurenty jako Intel, Broadcom a AMD; nutnost zarovnání pro hyperscalery a výrobce zařízení.

Podrobnosti

Článek vychází z historického pohledu na éru osobních počítačů, kdy Intel a Microsoft dominovaly díky Mooreovu zákonu, který sliboval zdvojnásobení výkonu každé dva roky. Nvidia nyní překonává tento model: místo dvouletého cyklu dosahuje ročních skoků, kde výkon stoupá pětkrát, propustnost desetkrát a poptávka po tokenech – základních jednotkách zpracování v jazykových modelech – patnáctkrát. Tento růst pohání Jevonsův paradox, podle kterého zlepšení efektivity vede k vyšší spotřebě zdrojů, protože aplikace se stávají náročnějšími.

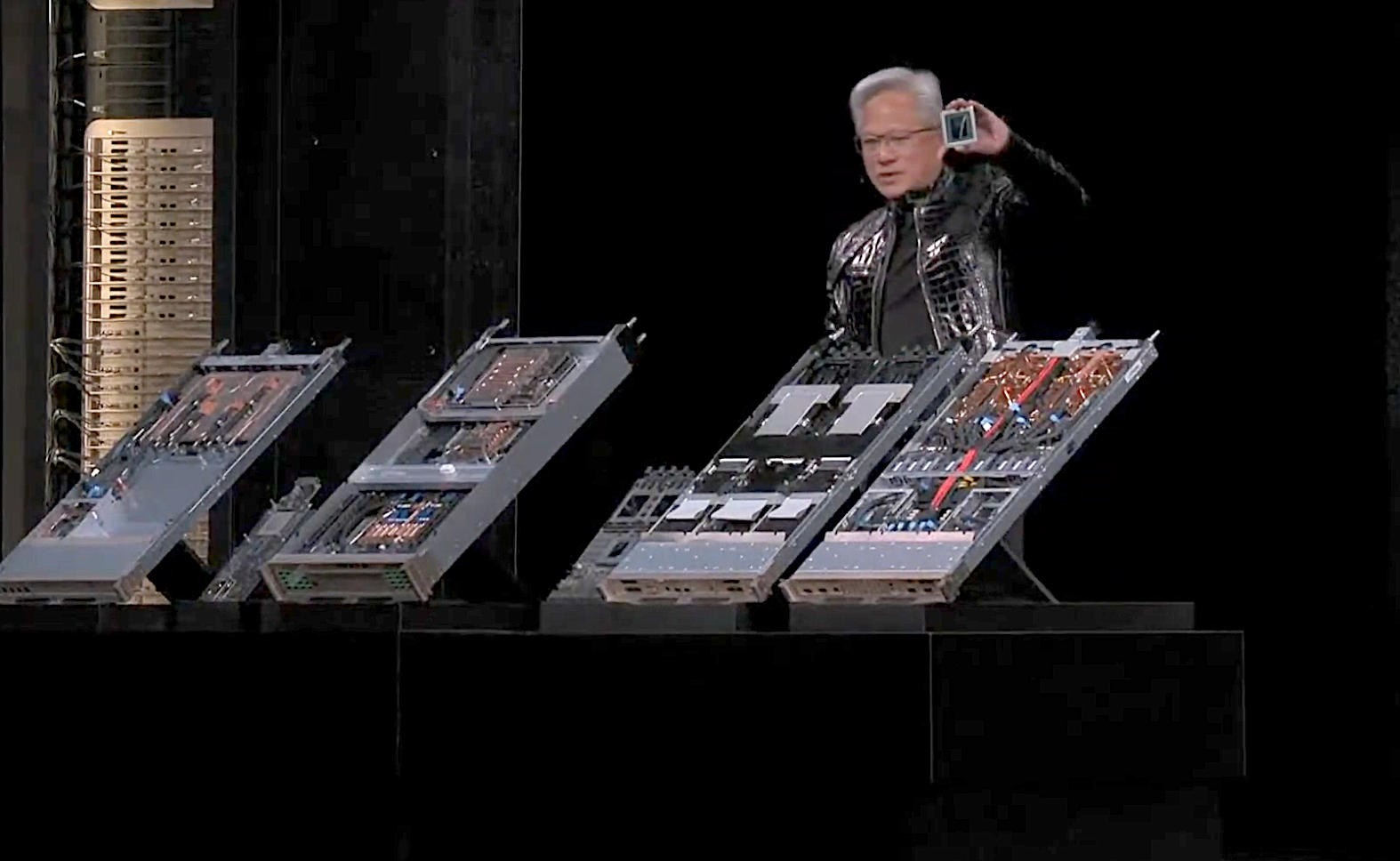

Jensen Huang na CES 2026 představil oznámení, která radikálně snižují náklady na provoz AI továren. Tyto továrny jsou masivní datová centra s tisíci GPU, určená k tréninku velkých jazykových modelů (LLM) jako GPT nebo Llama. Nové architektury GPU a související software umožňují vyšší využití hardwaru, což zvyšuje efektivitu a snižuje cenu za token. Například předchozí generace čipů Blackwell již slibovala obrovské skoky, ale CES přineslo další iterace, které integrují pokročilé síťové technologie pro rychlejší komunikaci mezi uzly.

Analýza porovnává Nvidia s Intelovou érou: firmy jako AMD přežily tím, že se začlenily do ekosystému, zatímco vyzývatelé jako Cyrix selhali. Dnes Nvidia vytváří podobný ekosystém kolem svých GPU, CUDA softwaru pro programování paralelních výpočtů a NVLink pro propojení čipů. Konkurenti jako Intel s Gaudi čipy, Broadcom se síťovými řešeními nebo AMD s MI300X GPU se snaží dohnat, ale Nvidia vede díky vertikální integraci – od návrhu čipů po optimalizovaný software.

Pro hyperscalery jako Google, Microsoft nebo Amazon to znamená nutnost investovat do Nvidia infrastruktury, aby zvládly rostoucí poptávku po AI. Výrobci zařízení (OEM) musí přizpůsobit servery Nvidia standardům, jinak riskují marginalizaci. Uživatelé – od výzkumných laboratoří po firmy zavádějící AI – získají levnější přístup k výpočetnímu výkonu, což urychlí nasazení aplikací jako autonomní vozidla nebo personalizovaná medicína.

Proč je to důležité

Tato oznámení posilují monopol Nvidia v AI hardwaru, což ovlivňuje celý technologický ekosystém. Zatímco předchozí éra umožnila širokou konkurenci, Nvidia vytváří “vítěz-beru-vše” dynamiku, kde nezarovnání vede k selhání, podobně jako Sisyfosův úkol. Pro průmysl to znamená vyšší investice do AI, rychlejší inovace v modelech jako Gemini nebo Claude, ale i rizika závislosti na jednom dodavateli. V širším kontextu urychluje přechod k AGI, kde výpočetní výkon je klíčový, a ovlivňuje geopolitiku kvůli omezenému přístupu k čipům.

Zdroj: 📰 SiliconANGLE News