Souhrn

Americké ministerstvo obrany, běžně nazývané Pentagon, se střetlo s vývojářem umělé inteligence Anthropic ohledně bezpečnostních omezení vestavěných do jeho technologií. Tyto omezení mají zabránit použití AI v autonomních smrtících zbraních bez lidského dohledu nebo v domácím sledování obyvatel. Spor způsobil pozastavení smlouvy v hodnotě až 200 milionů dolarů.

Klíčové body

- Pentagon tlačí na odstranění etických limitů v AI od Anthropic, aby mohl nasadit systémy pro autonomní cílení a sledování.

- Anthropic, firma specializující se na bezpečné AI modely jako Claude, se obává zneužití pro smrtící operace bez kontroly.

- Smlouva je pozastavena; zdroje mluví o šesti anonymních osobách obeznámených se situací.

- Konflikt odhaluje napětí mezi komerčními AI firmami a vojenskými potřebami.

- Reuters cituje, že armáda považuje omezení za přílišná.

Podrobnosti

Anthropic je kalifornská společnost založená v roce 2021 bývalými výzkumníky OpenAI, která se zaměřuje na vývoj velkých jazykových modelů (LLM) s důrazem na bezpečnost. Jejich hlavní produkt, model Claude, slouží k generování textu, analýze dat a řešení složitých úkolů, ale obsahuje tzv. ústavní AI – rámec, který vynucuje etické chování a zabraňuje škodlivým výstupům. Firma získala investice od gigantů jako Amazon a Google, celkem přes 7 miliard dolarů, což ji řadí mezi lídry v oblasti zodpovědného AI.

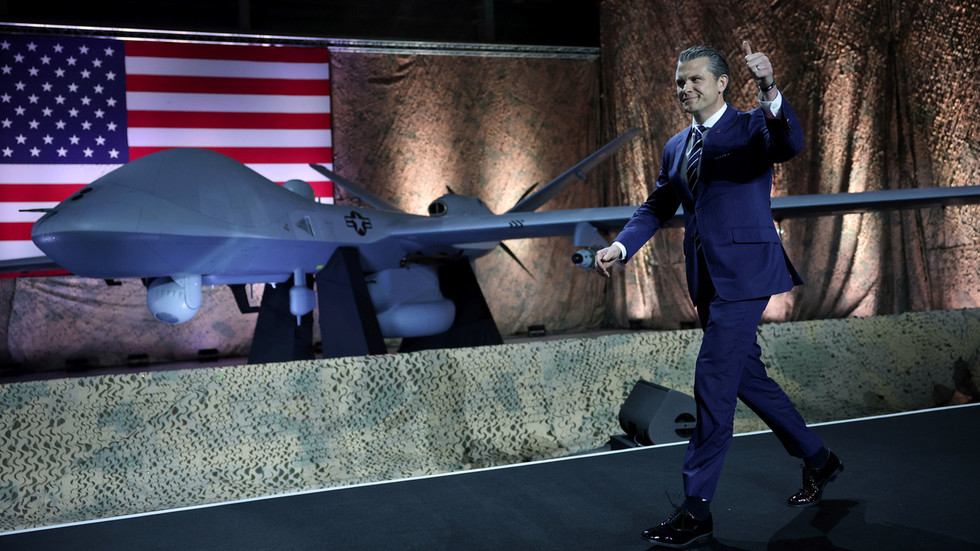

Pentagon chtěl integrovat tyto technologie do svých systémů pro autonomní zbraně, kde AI rozhoduje o útocích bez lidského zásahu, a pro sledování na domácí půdě, například kamerovými sítěmi nebo analýzou sociálních sítí. Podle zdrojů citovaných Reutersem armáda argumentuje, že omezení Anthropic omezují operační flexibilitu v bojových podmínkách. Anthropic naopak upozorňuje na rizika: chyby v AI by mohly vést k civilním obětem, eskalaci konfliktů nebo porušení ústavy kvůli masovému sledování Američanů.

Tento spor není ojedinělý. Podobné debaty probíhají kolem smrtících autonomních zbraňových systémů (LAWS), které OSN diskutuje od roku 2014. Firmy jako OpenAI a Google už dříve odmítly vojenské zakázky – OpenAI v roce 2024 zakázalo použití ChatGPT pro vývoj zbraní. Pentagon se proto obrací k jiným dodavatelům, jako Palantir nebo tradiční zbrojaři jako Lockheed Martin, kteří AI integrují bez takových etických brzd. Pozastavení smlouvy znamená, že Anthropic ztrácí potenciální příjem, ale udržuje svou reputaci v oblasti AI safety. Situace ilustruje, jak se komerční AI, původně určené pro civilní aplikace jako chatboti nebo data analýza, stávají vojenskými nástroji.

Proč je to důležité

Tento konflikt podtrhuje rostoucí napětí mezi rychlým vývojem AI a etickými normami. Pro průmysl znamená, že vojenské zakázky mohou nutit firmy k ústupkům od bezpečnostních standardů, což oslabí globální snahy o regulaci AI (např. EU AI Act nebo Bidenova výkonná směrnice z roku 2023). Pokud Pentagon uspěje, urychlí to vývoj killer robotů, což zvyšuje riziko náhodných útoků – AI systémy jako ty od Anthropic mají úspěšnost detekce cílů kolem 90 %, ale v reálném boji klesá kvůli nepředvídatelným faktorům. Pro uživatele a společnost to představuje hrozbu militarizace AI, kde technologie určené pro efektivitu končí v rukou armády bez dostatečných kontrol. Dlouhodobě to může vést k závodům ve zbraních mezi USA, Čínou a Ruskem, kde bezpečnostní prvky budou první obětí.

Zdroj: 📰 RT