Souhrn

Samsung plánuje zahájit hromadnou výrobu čipů HBM4 již příští měsíc, především pro Nvidia, která je dominantním dodavatelem grafických procesorů pro trénink velkých jazykových modelů. Tato nová generace vysokopásmové paměti (High Bandwidth Memory) přichází po řadě problémů s předchozími verzemi HBM3 a HBM3E, které Samsung musel redesignovat. Nvidia by tak mohla rozšířit svou nabídku AI akcelerátorů s vyšší kapacitou a rychlostí paměti.

Klíčové body

- Samsung očekává start masové produkce HBM4 v prosinci 2024, cíleně pro Nvidia GPU.

- Předchozí HBM3E čipy měly problémy s výkonem a spolehlivostí, což vedlo k redesignu v roce 2023.

- HBM4 nabídne až 16 vrstev paměti s kapacitou až 16 Gb na kostku, což umožní vyšší propustnost dat pro AI trénink.

- Nvidia zatím spolupracuje převážně se SK Hynix, ale Samsung se snaží získat větší podíl na trhu.

- Tento krok posílí dodávatelský řetězec pro AI hardware v době rostoucí poptávky po výpočetních clusterech.

Podrobnosti

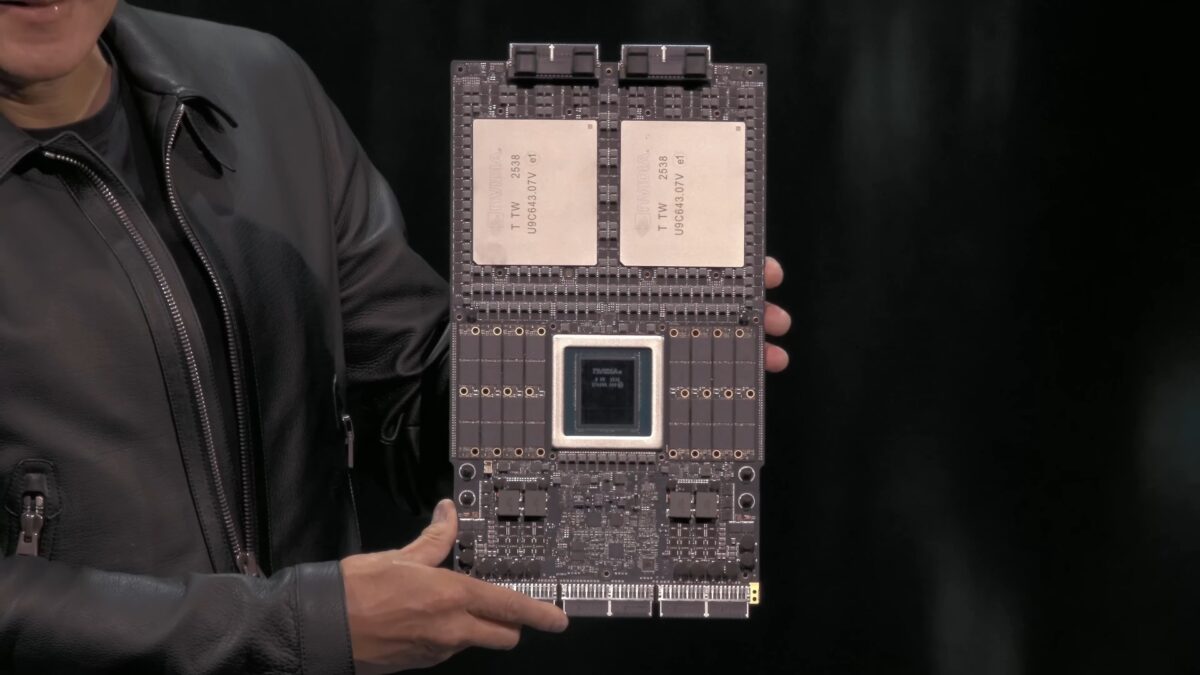

High Bandwidth Memory (HBM) je specializovaná paměťová technologie navržená pro vysokovýkonné aplikace, jako jsou grafické procesory (GPU) v akcelerátorech umělé inteligence. Na rozdíl od běžné GDDR paměti je HBM stackována vertikálně pomocí through-silicon vias (TSV), což umožňuje extrémně vysokou pásmovou šířku – až desítky terabajtů za sekundu na jeden čip. Nvidia ji využívá ve svých nejvýkonnějších produktech, jako jsou H100 a nadcházející Blackwell série (B200), kde slouží k rychlému přenosu dat mezi výpočetními jádry a pamětí během tréninku modelů jako GPT nebo Llama.

Samsung, jeden z tří hlavních výrobců HBM (spolu se SK Hynix a Micron), měl v minulosti potíže. Jeho HBM3 čipy vykazovaly nižší výkon v testech stability a teplotní odolnosti oproti konkurentům. V roce 2023 proto provedl redesign HBM3E, který zahrnoval vylepšení mikrostruktury a materiálů pro lepší signálovou integritu. Nvidia toto schválení udělila, ale omezeně – HBM3E od Samsungu se objevily jen v nižších verzích akcelerátorů, zatímco prémiové modely zůstaly na SK Hynix.

HBM4 představuje další skok: podporuje až 16-Hi stacky s hustotou 16 Gb na die, což znamená celkovou kapacitu až 288 GB na GPU v kombinaci s více kostkami. Propustnost dosáhne 1,6 TB/s a více, což je klíčové pro zpracování obřích datových sad v AI. Samsung tvrdí, že dosáhl výtěžnosti nad 80 % v testovací produkci a plánuje dodávky pro Nvidia H200 a Blackwell platformy. Tento krok je součástí širší strategie Koreje posílit pozici v AI dodavatelském řetězci, kde Nvidia kontroluje přes 90 % trhu s AI GPU. Bezpečnostní aspekty, jako ochrana proti chybám v paměti (ECC), byly také vylepšeny, aby se minimalizovaly výpadky během dlouhých tréninkových cyklů trvajících týdny.

Proč je to důležité

Tato novinka urychlí expanzi AI infrastruktury, protože Nvidia čelí nedostatku paměti pro své clustery, které pohánějí služby jako ChatGPT nebo xAI Grok. Samsungovo zapojení diverzifikuje dodávatele, snižuje rizika závislosti na SK Hynix a může snížit ceny HBM o 20–30 % díky větší konkurenci. Pro průmysl to znamená rychlejší nasazení nových generací AI modelů s miliardami parametrů, kde paměťový bottleneck byl dosud hlavní překážkou. V širším kontextu posiluje to geopolitickou roli jihokorejských firem v AI ekosystému, kde USA (Nvidia) spoléhají na asijskou výrobu. Dlouhodobě by HBM4 mohlo umožnit efektivnější edge AI aplikace v datech centrech i autonomních systémech, ale závisí na finálním schválení Nvidia a škálovatelnosti výroby.

Zdroj: 📰 SamMobile